Mostrar resumo Ocultar resumo

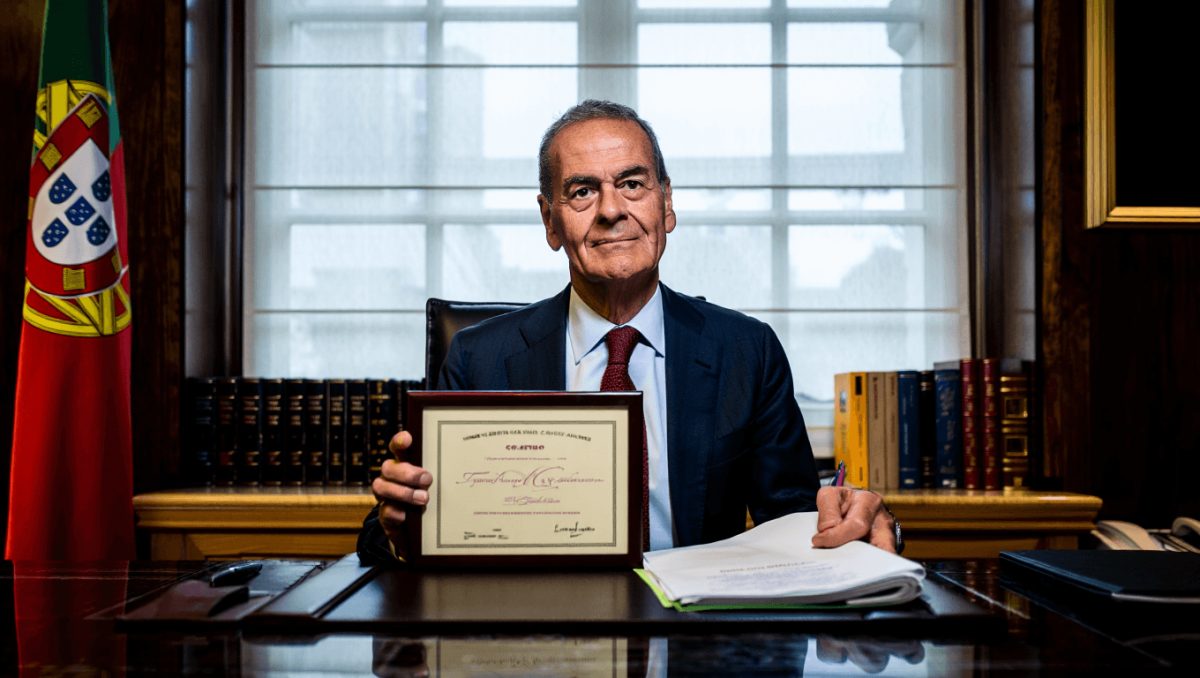

A capacidade da inteligência artificial de produzir imagens fotográficas de alta fidelidade com figuras públicas voltou ao centro do debate após um estudo que demonstra: é possível gerar, em segundos, fotografias falsas que colocam Jeffrey Epstein ao lado de líderes mundiais. Com a divulgação, na semana passada, do lote final de documentos do caso Epstein, a facilidade de criar montagens aumenta o risco de desinformação e de danos à reputação de pessoas envolvidas indiretamente.

O teste e os resultados

O levantamento foi conduzido pelo grupo de verificação de desinformação NewsGuard, que solicitou a três geradores de imagens baseados em IA a criação de fotos de Jeffrey Epstein com cinco autoridades: Donald Trump, Emmanuel Macron, Volodymyr Zelensky, Benjamin Netanyahu e Keir Starmer.

Resultado: as ferramentas responderam de forma muito diferente.

- Grok Imagine (xAI): produziu imagens descritas pelos autores do estudo como “falsificações convincentes” — e fez isso em segundos.

- Gemini (Google): recusou o pedido para gerar uma imagem com Donald Trump, mas criou imagens realistas com os outros quatro dirigentes em contextos sociais, como festas, jatos privados e praias.

- ChatGPT (OpenAI): recusou todas as solicitações envolvendo Epstein e as figuras testadas, citando restrições para gerar imagens sexualizadas de pessoas reais ou cenas de abuso.

Entre as imagens fabricadas pelo teste, há uma montagem que mostra um Trump aparentemente mais jovem ao lado de Epstein e de várias mulheres. Embora Trump tenha sido fotografado com Epstein em eventos sociais no passado, não existem registros verificados que o mostrem em situações envolvendo menores.

Por que isso importa agora

Na semana passada o Departamento de Justiça dos EUA liberou quase 3,5 milhões de páginas de arquivos sobre o caso Epstein, um material que reacende controvérsias e teorias. Em contexto de divulgação de documentos sensíveis, a capacidade de gerar imagens falsas em massa cria um ambiente propenso à circulação rápida de montagens virais — capazes de influenciar debate público e decisões políticas.

O próprio NewsGuard alertou que a facilidade de uso dessas ferramentas torna trivial para agentes mal-intencionados fabricar provas visuais que podem viralizar.

Exemplos e confusões recentes

Além das imagens, circulou recentemente uma mensagem falsa atribuída a Donald Trump que dizia que ele removeria tarifas contra o Canadá caso Mark Carney — ex-governador do Banco do Canadá e do Banco da Inglaterra, e nunca primeiro‑ministro — admitisse ligações a Epstein. Uma análise da AFP não encontrou evidências de envolvimento de Carney nos arquivos do caso.

O que os testes mostram, em resumo

- Há diferentes níveis de filtragem entre provedores de IA; políticas e critérios variam.

- A velocidade e qualidade das imagens falsas já alcançam padrão suficiente para enganar o público.

- Liberação de documentos e episódios políticos aumentam a probabilidade de uso malicioso dessas imagens.

Como se proteger

Para leitores e profissionais de mídia, algumas medidas práticas reduzem o risco de serem enganados por montagens:

- Fazer busca reversa da imagem (Google Imagens, TinEye) para checar origem.

- Verificar se veículos confiáveis ou agências de checagem confirmaram a foto.

- Consultar metadados quando disponíveis e desconfiar de imagens sem contexto claro.

- Priorizar fontes primárias (declarações oficiais, fotos de agências) antes de compartilhar.

O episódio reforça um ponto simples e atual: com modelos de IA cada vez mais acessíveis, imagens não comprovadas exigem verificação apurada. Plataformas, pesquisadores e legisladores enfrentam agora o desafio de equilibrar inovação com salvaguardas que protejam pessoas e instituições contra danos causados por falsificações visuais.